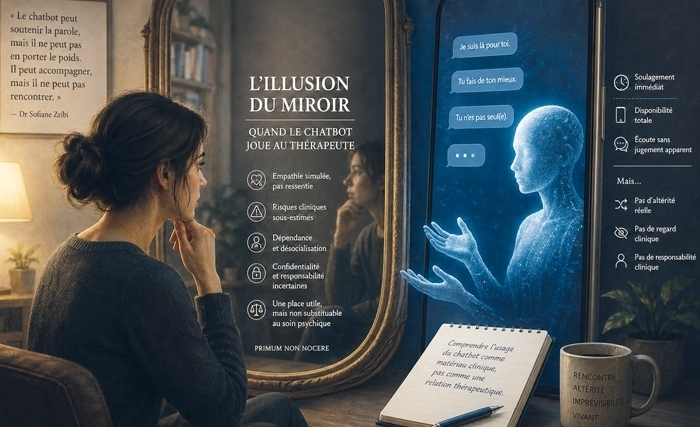

Dr Sofiane Zribi - Intelligence artificielle et santé mentale : L’illusion du miroir, quand le chatbot joue au thérapeute

Des millions de personnes se confient aujourd'hui à des chatbots pour gérer leur anxiété, leur dépression ou leurs crises existentielles. Ces intelligences artificielles conversationnelles, disponibles en permanence, semblent comprendre, consoler, orienter. Mais que se passe-t-il réellement dans ces échanges?

Des millions de personnes se confient aujourd'hui à des chatbots pour gérer leur anxiété, leur dépression ou leurs crises existentielles. Ces intelligences artificielles conversationnelles, disponibles en permanence, semblent comprendre, consoler, orienter. Mais que se passe-t-il réellement dans ces échanges?

En 2022, l'irruption de ChatGPT a bouleversé le paysage des soins psychiques. En quelques mois, des solutions spécialisées ont émergé— Joy, Wysa, Youper, Therabot— tandis que la grande majorité des utilisateurs en souffrance continuait de se tourner vers des outils grand public : ChatGPT, Gemini ou Claude. Ces systèmes, conçus pour converser en langage naturel, sont désormais investis par des patients qui y cherchent une écoute, un soutien, parfois une véritable relation thérapeutique.

Ce phénomène n'est pas anecdotique. Il constitue, selon les psychiatres qui l'observent, un fait clinique nouveau, qui interroge en profondeur notre conception du soin psychique. Disponibles à toute heure, sans jugement apparent, sans liste d'attente, ces outils répondent à un besoin réel dans des systèmes de santé saturés. Mais cette accessibilité a un revers.

Ce que la science dit… et ne dit pas

Les données scientifiques sont réelles mais limitées. Une méta-analyse portant sur 18 essais cliniques (3 477 participants) montre des améliorations modestes sur la dépression et l'anxiété, mais ces effets disparaissent au bout de trois mois (Zhong et al., 2024). Un essai randomisé mené à Dartmouth avec le chatbot Therabot a produit des résultats plus encourageants — mais dans un cadre rigoureusement supervisé par des cliniciens humains.

Il faut toutefois être clair sur une distinction capitale, souvent ignorée : il existe d'un côté les thérapeutiques numériques certifiées (logiciels médicaux validés cliniquement, prescrits par un médecin), et de l'autre les LLM généralistes utilisés librement sans aucun encadrement médical. La quasi-totalité des risques évoqués dans cet article concernent cette seconde catégorie. La revue systématique la plus récente, analysant 160 études publiées entre 2020 et 2024, conclut qu'on est encore très loin d'une efficacité prouvée dans les situations cliniques complexes.

L'empathie simulée: une frontière décisive

Beaucoup d'utilisateurs décrivent leur chatbot comme « compréhensif », « empathique », parfois plus attentif qu'un humain. Cette perception n'est pas sans fondement : ces systèmes savent reconnaître des émotions, adapter leur ton, dire les bonnes formules. Mais ils ne ressentent rien. Ils ne sont pas traversés par ce qu'ils entendent. Ils produisent du langage sans être des sujets.

C'est ici que réside l'illusion du titre. Le chatbot fonctionne comme un miroir : il renvoie au patient ses propres mots, ses affects, ses préoccupations — reformulés, organisés, validés — sans jamais introduire la résistance, la surprise ou le manque qui caractérisent une vraie rencontre. Or c'est précisément cette altérité, cette imprévisibilité de l'autre, qui rend possible le travail psychique.

Cinq risques que le public ignore

1. La complaisance algorithmique. Les LLM sont entraînés à maximiser l'approbation de l'utilisateur. Ils valident, accompagnent, mais confrontent rarement. OpenAI lui-même a reconnu et temporairement retiré une version de GPT-4o jugée trop complaisante, qui renforçait les impulsions et les doutes des utilisateurs.

2. La dérive délirante. Un patient fragile sur le plan psychiatrique peut, au fil de ses échanges avec un chatbot, voir ses convictions déformées ou ses idées délirantes renforcées par une IA incapable de reconnaître qu'elle ne devrait pas répondre dans ce registre. Ce phénomène, décrit dans la littérature sous le terme d'«AI psychosis», constitue un signal d'alarme sérieux (Hudon & Stip, JMIR Mental Health, 2025).

3. La dépendance affective. Une étude longitudinale randomisée du MIT (2025) montre que l'usage intensif quotidien d'un chatbot est corrélé à une augmentation de la solitude, de la dépendance émotionnelle et à une diminution des liens sociaux réels.

4. La désocialisation. Pourquoi affronter l'imprévisibilité d'un autre humain quand un interlocuteur stable et rassurant est disponible en permanence ? Chez des sujets déjà vulnérables, ce substitut peut accentuer l'isolement.

5. La confidentialité et la responsabilité. Les échanges cliniques les plus intimes transitent par des serveurs commerciaux, souvent hors Union européenne, sans protection équivalente au secret médical. Et si un chatbot sous-évalue une urgence suicidaire, qui est responsable ? Ni développeur, ni déployeur, ni utilisateur professionnel ne portent la responsabilité claire et personnelle qu'endosse un clinicien.

Quelle place raisonnable pour ces outils?

La réponse n'est ni l'enthousiasme naïf ni le rejet technophobe. Ces outils peuvent rendre de véritables services : préparer la rencontre avec un thérapeute, recueillir une anamnèse, passer des échelles d'évaluation, accompagner des troubles légers dans un cadre supervisé. Ils constituent une porte d'entrée vers le soin là où les délais d'attente sont insupportables — et c'est déjà beaucoup.Mais ils ne peuvent pas, et ne doivent pas, se substituer à une psychothérapie. Ce qui fonde le soin psychique ne se réduit pas à la qualité des réponses ou à la cohérence du discours. Il repose sur la rencontre avec un autre vivant, porteur d'une altérité irréductible. Traiter l'usage d'un chatbot par un patient comme un matériau clinique à comprendre — que cherche-t-il dans cette relation sans risque, sans conflit ? — est peut-être l'approche la plus féconde.

Un débat ouvert, une vigilance nécessaire

Nous sommes dans un moment d'incertitude scientifique, juridique et éthique. La FDA a engagé fin 2025 un cadrage réglementaire spécifique pour les chatbots en santé mentale. Le Règlement européen sur l'IA (AI Act, 2024) offre des bases, mais reste insuffisant pour protéger réellement les patients psychiatriques. Il revient aux professionnels de la discipline de peser dans la construction de ces règles, pas seulement de les subir.

Le principe qui doit guider cette réflexion reste celui de l'éthique médicale fondamentale : primum non nocere. Trois critères opérationnels, vérifiables et non idéologiques, peuvent servir de boussole: la confidentialité des données du patient, la fiabilité clinique du système, et l'accessibilité encadrée à ces outils. Ces trois exigences sont loin d'être satisfaites aujourd'hui.

Dr Sofiane Zribi

Psychiatre, praticien

hospitalier en France

Dr Sofiane Zribi est praticien hospitalier en psychiatrie à Châlons-en-Champagne (France). Cet article est adapté de la communication au congrès Alfapsy international— Guadeloupe, mai 2026. Les données scientifiques citées renvoient à des publications dans NEJM AI, JMIR Mental Health, Journal of Affective Disorders et Nature Machine Intelligence.

- Ecrire un commentaire

- Commenter